Projekte in REVISE

ChARM: Chat Control, Age Verification and Resilience for Minors

Das Projekt untersucht den technischen Schutz von Minderjährigen im Internet und die Herausforderungen bei der Erkennung illegaler Inhalte wie CSAM und Cybergrooming, insbesondere im Kontext der geplanten EU-Vorschriften. Die Diskussion über Maßnahmen wie das Scannen von Online-Kommunikation wirft Fragen zur Privatsphäre und zur Genauigkeit der Technologien auf, deren Fehlerraten bisher hoch sind. ATHENE bietet ein Umfeld, in dem technologische Lösungen entwickelt und bewertet werden können, um den Schutz Minderjähriger zu verbessern und EU-Vorgaben zu erfüllen. Im Projekt CHARM werden dazu der Stand der Technik analysiert, Demonstratoren erstellt und neue Schutzmethoden entwickelt, um Politik, Wirtschaft und Gesellschaft besser zu informieren.

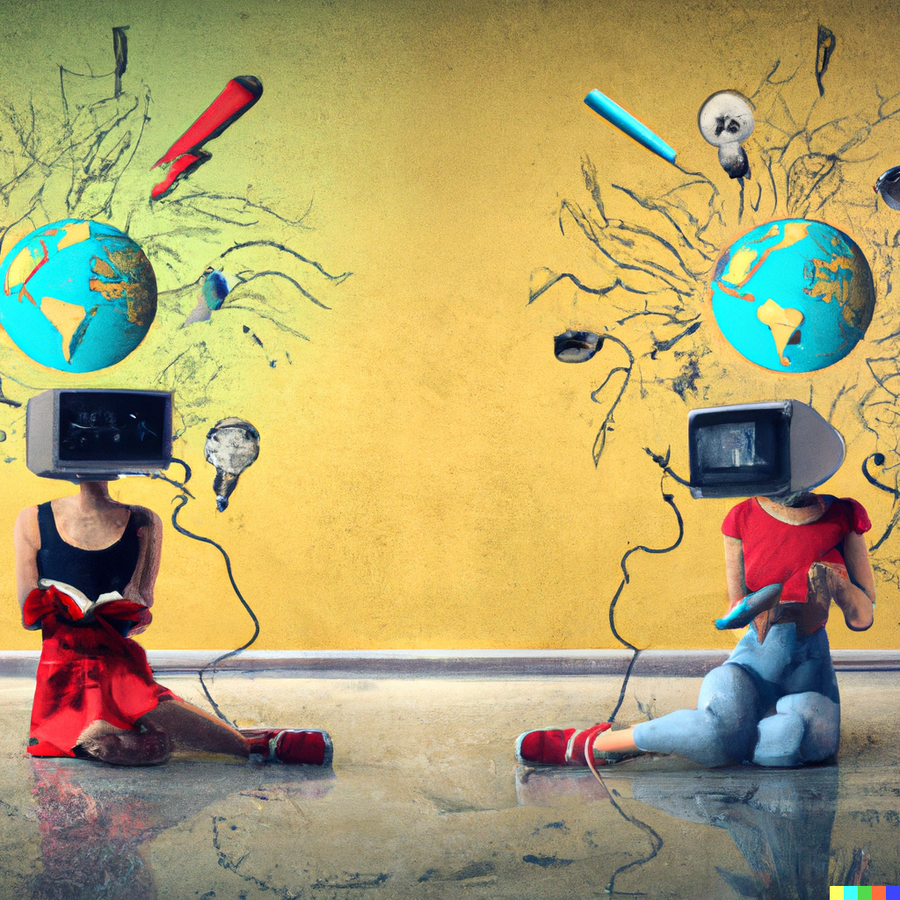

CRISIS: Cross-Domain Disinformation Analysis

Nachrichten werden heutzutage immer häufiger über die sozialen Medien verbreitet und konsumiert. Da Beiträge vor der Veröffentlichung nicht geprüft werden, befinden sich darunter auch viele Falschinformationen. Im Projekt CRISIS werden Beiträge in den sozialen Medien nachträglich auf Desinformationen hin untersucht, wobei hierbei sowohl Informationen in Texten als auch in anderen Multimedia Daten, wie Bildern, Videos und Ton betrachtet werden. Dabei kommen verschiedene Analysemethoden des maschinellen Lernens zum Einsatz, die

- es ermöglichen, Verbreitungswege von (Des-) Informationen nachzuvollziehen,und die in den Nachrichten vorherrschenden Themen und Trends zu ermitteln (Social Media Analytics),

- ggf. böswillig „recycelte“ Inhalte wiedererkennen und auf ihre ursprüngliche authentische Quelle zurückverfolgen oder Sachverhalte bereits durchgeführter Faktenprüfungen zuordnen (Semantic Similarity Analysis), und

- eine manuelle Faktenprüfung unterstützen, indem besonders prüfenswerte Medien vorselektiert werden (Check-Worthiness Analysis).

Die Ergebnisse fließen in einen Demonstrator ein, der Bedarfsträger*innen, wie Journalist*innen und Faktenprüfer*nnen, bei der Untersuchung und Identifizierung von Desinformationen unterstützen soll.

CYNTRA – Towards an Effective Multi-Label Classification and Model Auditing Ecosystem for Combatting Textual Online Hate Speech

Online-Hassrede stellt Strafverfolgungsbehörden und Meldestellen vor wachsende Herausforderungen. Mit der Integration des überarbeiteten Verhaltenskodex zur Bekämpfung illegaler Hassrede in den Digital Services Act der EU wird die Rolle dieser Organisationen als Trusted Flagger gestärkt. Gleichzeitig reduzieren große Social-Media-Plattformen ihre Moderationskapazitäten – das Volumen zu bearbeitender Fälle steigt, während die manuelle Bearbeitung an ihre Grenzen stößt.

CYNTRA entwickelt ein umfassendes Ökosystem zur Analyse textueller Online-Hassrede durch KI-basierte Multi-Label-Klassifikation. In empirischen Fallstudien in Deutschland und Großbritannien vergleicht das Projekt romano-germanische und anglo-amerikanische Ansätze der Klassifikation von Hassrede. Das Ökosystem umfasst erweiterte Datensätze mit Expertenannotationen, anpassbare Klassifikationsmodelle einschließlich Large Language Model-Prompting sowie ein nutzerorientiertes Dashboard für Fallanalysen und Systemaudits. Ziel ist es, Meldungen effizienter zu priorisieren und KI-Modelle kontinuierlich an sich verändernde rechtliche und sprachliche Anforderungen anzupassen.

DREAM: Deepfake REcognition and Artificial Media

Im Projekt DREAM werden Methoden zur Erkennung von Medieninhalten erforscht, die mittels künstlicher Intelligenz erzeugt oder manipuliert wurden. Hierbei liegt ein spezieller Fokus auf der Erkennung von Manipulationen im Bild-, Video- und Audiobereich, die zum Ziel haben, die Identität einer Person nachzustellen. Sogenannte Deepfakes sind in der Lage, in Bildern oder Videos auftretende Gesichter mit Gesichtern beliebiger Personen mithilfe von “Deep Learning” automatisiert zu ersetzen. Bilder können durch Text-to-Image-Synthese Verfahren wie DALL-E, StableDiffusion oder Midjourney, erzeugt werden. Für Videos können hierzu Face Swapping oder Facial Reenactment Techniken wie “Lip-Sync Angriffe” zum Einsatz kommen. Bei Audiodaten hingegen wird die Stimme einer bestimmten Zielperson z.B. durch Voice Conversion oder Text-to-Speech Synthese nachgeahmt, so dass dieser Worte in den Mund gelegt werden können. Um multimodale Manipulationen besser zu verstehen, sollen diese Fälschungen im Rahmen des Projekts auch selbst erstellt werden.

TRACE: Tracing and Recognizing AI-generated Conten and Evidence

TRACE ist ein Forschungsprojekt zur fortschrittlichen Forensik für generative KI und Deepfakes. Da synthetische Audio-, Video-, Bild- und Textinhalte immer realistischer werden, reicht es nicht mehr aus, lediglich zu erkennen, ob etwas gefälscht ist. Bei realen Ermittlungen – beispielsweise zu politischen Deepfakes, Finanzbetrug mit gefälschten Führungskräften in Videoanrufen oder KI-generierten Robocalls bei Wahlen – müssen Ermittlende nicht nur erkennen, dass etwas gefälscht ist, sondern auch wissen, wie die Inhalte erstellt wurden, welche Tools verwendet wurden und welches Ausgangsmaterial möglicherweise beteiligt war.

TRACE konzentriert sich auf die Herkunft von Modellen und KI-Fingerabdrücke. Es sucht nach subtilen, konsistenten Spuren, die generative Modelle hinterlassen, um zu identifizieren, welche Systeme oder Methoden ein bestimmtes Medienelement erzeugt haben. Das Projekt zielt darauf ab, den generativen Prozess selbst zu profilieren, modellspezifische Artefakte aufzudecken, Manipulationstechniken abzuleiten und Metadaten zu generieren, die als robuste forensische Beweise verwendet werden können.

Im Forschungsbereich REVISE und neben ATHENE-Projekten wie DREAM ergänzt TRACE die klassische Deepfake-Erkennung um eine erklärende Ebene. Es schlägt eine Brücke zwischen technischer Forensik und rechtlichen Anforderungen, unterstützt die Faktenprüfung und Strafverfolgung und verbessert die Analyse von Desinformationsmustern und Frühwarnsystemen. Das Ziel besteht darin, die Mediensicherheit und das digitale Vertrauen zu stärken, indem KI-generierte Inhalte transparenter und nachvollziehbarer gemacht werden.

TXAITD: Trustworthy and Explainable AI-generated Text Detection

Die beispiellosen Fähigkeiten neuer Large Language Models (LLMs) wie ChatGPT und Bard machen sie zu attraktiven Schreibassistenten. Da diese Modelle jedoch Texte produzieren, die oft nur schwer von menschlichen zu unterscheiden sind, werden LLMs zunehmend auch für böswillige Zwecke eingesetzt, z. B. für das automatische Schreiben von Lernaufgaben, das Verfassen von KI-generierten wissenschaftlichen Arbeiten, die Verbreitung von Fake News und für Social-Engineering-Angriffe. Um diese Probleme zu bekämpfen, konzentriert sich dieses Projekt auf die Entwicklung von vertraunswürdiger und erklärbarer KI-generierter Text Identification (TXAITD -- Trustworthy and Explainable AI-generated Text Detection). TXAITD soll die KI-Nutzung in Texten genau lokalisieren und Erklärungen zu ihrer etwaigen bösartigen Verwendung aufführen. Dieser Ansatz hilft, den gutartigen Einsatz von KI als Schreibassistent von ihrem bösartigen Gebrauch zu unterscheiden. Im Gegensatz zu früheren Technologien macht TXAITD den Erkennungsprozess transparent, damit menschliche Nutzer und Entscheidungsträger fundierte Urteile über digitale Inhalte fällen können. Letztlich trägt TXAITD zur sicheren digitalen Transformation und zur Regulierung von KI in der Textgestaltung bei.